В этой статье мы расскажем о принципах тестирования разблокировки LHR на примере популярного майнера GMiner. Команда майнинг-пула 2miners возглавила

Как увеличить хешрейт в майнинге. Метод разблокировки LHR-видеокарт с GMiner

В этой статье мы расскажем о принципах тестирования разблокировки LHR на примере популярного майнера GMiner. Команда майнинг-пула 2miners протестировала работу майнера с видеокартами GeForce RTX 3080 Ti, но принципы применимы к любой видеокарте LHR. Делимся результатами тестирования.

Мы расскажем, как определить наличие ограничителя майнинга LHR в видеокартах NVidia RTX 3060, RTX3060 ti, RTX 3070, RTX 3080

1 Способ. По названию.

Все видеокарты RTX 3090 не имеют ограничений на майнинг.

Видеокарта RTX 3060 имеет два типа программной блокировки, которая уже была взломана, и LHR. Маркировка LHR для этой видеокарты также не указывается, так как изначально эти видеокарты выпускались с блокировкой майнинга.

Все видеокарты Nvidia RTX 3070 Ti и RTX 3080 Ti оснащены ограничителем майнинга LHR, даже если это не указано в названии и на упаковке с видеокартой.

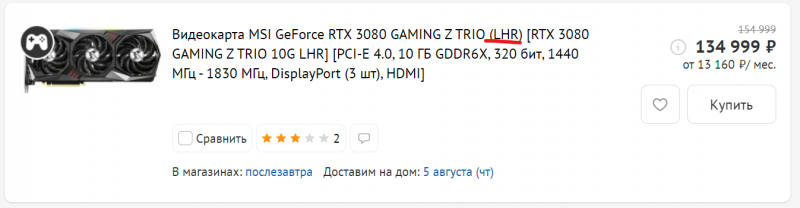

Для видеокарт RTX 3060Ti, RTX 3070 и RTX 3080 производитель может указать на упаковке или в названии продаваемой видеокарты новую ревизию, в которой реализована технология Lite Hash Rate (LHR). В этом случае сразу видно, что при майнинге такие видеокарты будут показывать заниженную хешрейт.

Если в названии модели не указано, что это модель LHR, к сожалению, это не означает, что это старая ревизия без ограничений майнинга. Это может быть LHR или обычная видеокарта.

Почему производители вводят покупателей в заблуждение: намеренно или ненамеренно. Остается только догадываться.

Если вы встретите видеокарту без обозначения LHR, вы будете использовать другие методы, чтобы проверить эту видеокарту на предмет ограничений для майнинга.

Выбирая видеокарту, важно учитывать, для какой цели она будет использоваться. Также важно знать, что означает TI в видеокартах NVIDIA и других

Сравнение

Несмотря на то, что GEFORCE GTX 1050 является представителем среднего класса, она характеризуется как игровая видеокарта, о чем свидетельствует обозначение GTX. Общие параметры включают аппаратную поддержку DirectX версии 12, что значительно улучшает качество игры. Это хорошо видно в игре Rise of the Tomb Raider. Разработчики смогли сделать так, чтобы этот параметр увеличивал прирост производительности за счет видеокарты. Еще одно распространенное качество — это чип, который был разработан на уникальной архитектуре Паскаля. Обе модели объединяет используемый формат памяти — GDDR5.

Обычная версия GTX 1050 имеет всего два гигабайта видеопамяти, чего уже недостаточно (или почти не хватает) в современных играх. У этого представителя пятого поколения всего ядра CUDA 640. Хотя частоты у обычного варианта самые высокие — 1455 мегагерц.

Отличие gtx. Что означает Ti в видеокартах Nvidia? Линии и знаки видеокарт NVIDIA Выбор видеокарты — задача не из легких, так как производители выпускают устройства в больших количествах.

Выводы сайт

- GTX может обрабатывать в 2-4 раза больше информации за один такт, чем видеокарты GT

- Карты GTX превосходят GT, что делает их более экологически чистыми

- Соотношение цены и качества для GTX более оптимальное, чем для GT

- Производительность карт GTX превосходит GT.

Прежде чем сделать выбор, часто бывает сложно понять его позиционирование в линейке, а также его характеристики и производительность. Эта статья призвана пролить свет на эту проблему и рассказать вам об основных линейках видеокарт NVIDIA, их поколениях, назначении, маркировке и производительности.

Трассировка лучей, тензоры ядра, Тьюринг и Паскаль — все это влияет на видеокарты. Сегодня мы полностью разберемся, как они работают.

Как работает видеокарта NVIDIA? Разбор

Мы привыкли думать о видеокартах как о дополнении к основному процессору. А еще есть встроенные видюхи. Но действительно. Видеокарта — это компьютер в компьютере, который выполняет гораздо больше операций, чем остальная часть системы. Посмотреть на себя:

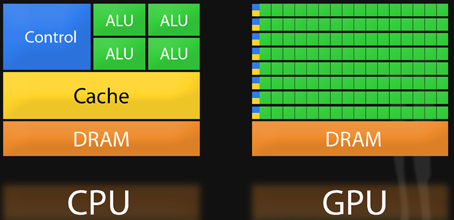

- Центральный процессор имеет 4, 8 или, может быть, 16 ядер. На видеокарте тысячи вычислительных блоков!

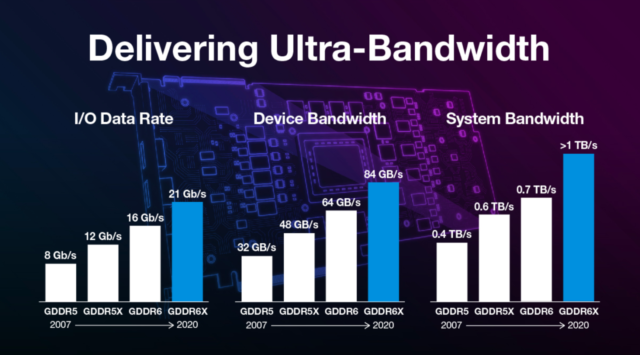

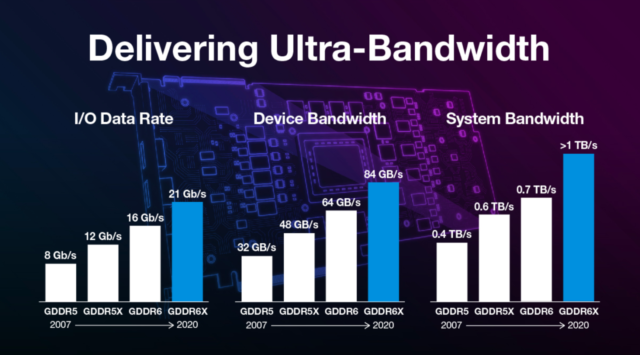

- Он имеет миллиарды транзисторов, гигабайты видеопамяти с пропускной способностью до одного терабайта в секунду.

- И все это потребляет энергию, весит и стоит как отдельный компьютер!

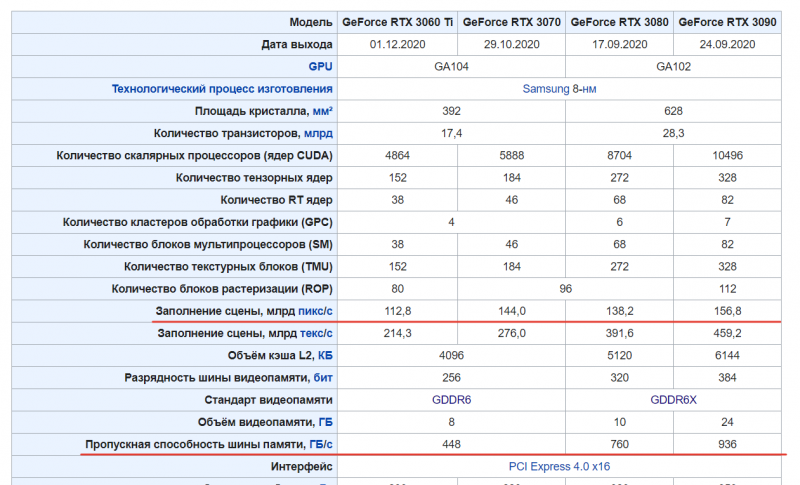

Например, особенности GeForce RTX 3090:

- Ядро CUDA: 10496 | Тензорное ядро: 328 | Ядро трассировки лучей: 82

- 28 миллиардов транзисторов

- Видеопамять: 24 ГБ GDDR6X

- Пропускная способность системной памяти:> 1 ТБ / с

- Цена: от 136 990 руб.

Но раз уж видюхи такие производительные, зачем нам центральный процессор? А в чем разница между процессором и графическим процессором?

А чем видеокарты друг от друга отличаются? Как такая бандура вписывается в ноутбук? И главное выяснить, можно ли играть в Cyberpunk 2077 на ноутбуке с ультра настройками. Давайте поговорим об этом и многом другом в отличном анализе!

В наши дни видеокарты могут делать много вещей и часто выполнять некоторые задачи намного быстрее и эффективнее, чем процессор? Но до такого положения вещей мы дошли не сразу. Первые видеокарты правильнее было бы назвать ASIC (Application-Specific Integrated Circuit), то есть специальными интегральными схемами. Что это значит?

Центральный процессор представляет собой универсальный чип. Он может выполнять совершенно разные типы задач. Это связано с тем, что каждое ядро центрального процессора состоит из множества различных блоков, каждый из которых знает, как выполнять свой собственный тип вычислений.

Это удобно, ведь на центральном процессоре мы можем делать любые расчеты. И в принципе, огромный CPU может полностью заменить все остальные чипы. Но, конечно, это будет малоэффективно. Поэтому для конкретных задач на помощь центральному процессору часто приходят сопроцессоры или ASIC, то есть отдельные острые микросхемы для эффективного решения конкретной задачи.

Итак, в середине 90-х такой конкретной задачей было ускорить первые 3D-игры, такие как Quake!

Первые видеокарты

Без разгона Quake казался второстепенным. Все очень пиксельное и медленное.

Но надо было купить себе волшебный 3D-ускоритель. Подключите его к основной 2D-видеокарте извне с помощью короткого кабеля VGA. Да, да, раньше было так. И Quake становился чем-то запредельным. Игра стала плавной, красочной и, что самое главное, работала с высоким для того времени разрешением и, как следствие, без пикселей.

Тогда это было почти похоже на волшебство. Но в чем причина столь радикального улучшения картины? Чтобы ответить на этот вопрос, давайте разберемся, как видеокарта работает поэтапно.

Как работает видеокарта?

Этап 1. Растеризация.

3D-объект изначально является векторным. Он состоит из треугольников, которые можно описать вершинами. То есть, по сути, объект представляет собой набор вершин с их координатами в трехмерном пространстве.

Но ваш экран двухмерный и даже состоит из пикселей. Итак, как нам создать векторный 3D-объект в 2D-пространстве? Правильно: брось!

Переносим координаты вершин на плоскую поверхность, соединяем их уравнениями прямых на плоскости и заливаем пиксели плоскости треугольников. На этом этапе мы получаем двухмерную проекцию объекта на экран.

Этап 2. Текстурирование

Далее нам нужно как-то раскрасить модель. Поэтому текстура растягивается на растеризованный объект до координат текстуры.

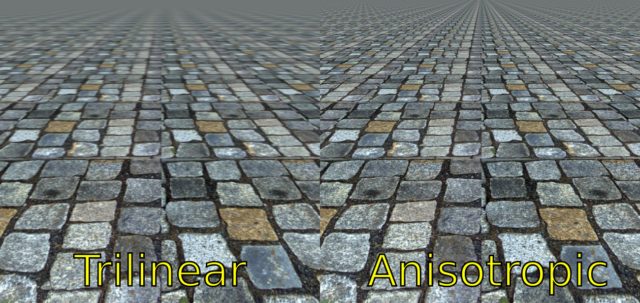

Но простого растягивания текстуры недостаточно, ее нужно как-то сгладить. В противном случае, когда вы приблизитесь к объекту, вы просто увидите сетку текселей. Как и в ранних 3D-играх, таких как DOOM. Поэтому к текстуре затем применяются различные алгоритмы фильтрации.

Ранние видеокарты использовали билинейную интерполяцию. Вы видели это в примере с Quake. Все, что он делает, это линейно интерполирует промежуточные цвета между четырьмя текселями, и результирующее значение становится цветом пикселя на экране.

Эта интерполяция сейчас активно используется. Но помимо этого они также выполняют трилинейную интерполяцию — это еще более продвинутая версия сглаживания, но она используется только на стыках различных уровней детализации текстуры, чтобы замаскировать их.

Но для восстановления четкости текстур по углам относительно камеры используется анизотропная интерполяция. Чем выше его коэффициент, тем четче изображение, поскольку для получения цвета каждого пикселя делается до 16 образцов. Особенно это заметно на поверхностях под острым углом к камере. То есть, например, на полу.

Хорошо, теперь у нас есть цветное изображение. Но этого все равно недостаточно, потому что в сцене нет освещения. Поэтому перейдем к следующему этапу с интригующим названием пиксельного шейдера или пиксельного шейдера.

Этап 3. Пиксельный шейдер.

В общем, шейдер — это элемент, который позволяет программисту делать что-то с вершинами, треугольниками и пикселями на программном уровне. В случае пиксельных шейдеров это дает разработчику возможность динамически изменять цвет каждого пикселя на экране в зависимости от программы.

К слову, поддержка простых шейдеров впервые появилась в 2001 году, когда появилась NVIDIA GeForce 3. До этого тоже было освещение, но железо и разработчики не могли особо повлиять на результат. Так что на сегодняшний день это наиболее ресурсоемкая фаза, где для каждого пикселя необходимо рассчитать, как он отражает, рассеивает и пропускает свет. Как тени падают на поверхность модели и т.д. Другими словами, вычисляется окончательный цвет пикселя.

Каждый объект сцены описывается с помощью разных текстур:

- Карта нормалей, текстура, в которой хранятся векторы нормалей для каждой точки на поверхности. Освещенность на пиксель рассчитывается с использованием этих векторов.

- Карта зеркала, показывающая, сколько света отражается от поверхности.

- Карта шероховатости, которая описывает микрорельеф поверхности или то, как поверхность будет рассеивать свет.

- Карта альбедо, то есть карта диффузии или естественного цвета объекта.

- И другие.

Этап 4. Сохранение

После серии расчетов с использованием информации со всех вышеперечисленных графиков наступает последний этап. Мы получили цвет финального пикселя и сохранили его в видеопамяти. И после обработки всей сцены мы уже можем просматривать изображение на экране.

Мощность

Все эти расчеты нужно производить очень быстро и, главное, параллельно. Например, чтобы создать изображение 4K 60 раз в секунду, вам нужно вычислить цвет примерно в полмиллиарда пикселей. А если мы хотим 120 FPS, это миллиард. Именно поэтому видеокарты по структуре отличаются от центрального процессора.

Центральный процессор предназначен для последовательного, но очень быстрого выполнения множества различных вычислений. Поэтому в центральном процессоре мало ядер, но они способны быстро щелкнуть любую активность. Но в графическом процессоре тысячи вычислительных блоков, они не могут выполнять задачи с небольшим объемом данных последовательно как процессор как можно быстрее, но они очень быстро выполняют параллельные вычисления с большим объемом данных. Например, NVIDIA GeForce RTX 3090 на своем пике может выполнять до 38 триллионов операций с плавающей запятой в секунду.

Поскольку видеокартам приходится постоянно загружать и выгружать огромное количество данных в памяти, они также используют свой тип памяти: GDDR. У него более высокая задержка, чем у обычного DDR, поэтому нет смысла использовать память, такую как RAM. Но GDDR имеет значительно большую ширину канала и пропускную способность, которая уже сейчас достигает 1 ТБ в секунду.

Это позволяет видеокартам обрабатывать сотни миллиардов пикселей в секунду.

Неужели вся эта сила нужна только для игры? Не совсем. Видеокарты давно используются в профессиональной деятельности.

Но это стало возможным только в 2006 году, когда была выпущена карта GeForce 8800, в которой впервые появились ядра CUDA — Compute Unified Device Architecture. Это унифицированные ядра, которые впервые позволили использовать видеокарту не только для игр, но и для любой массовой параллельной обработки: типа рендеринга видео, моделирования воды, курения или майнинга криптовалюты, если вдруг это все еще актуально.

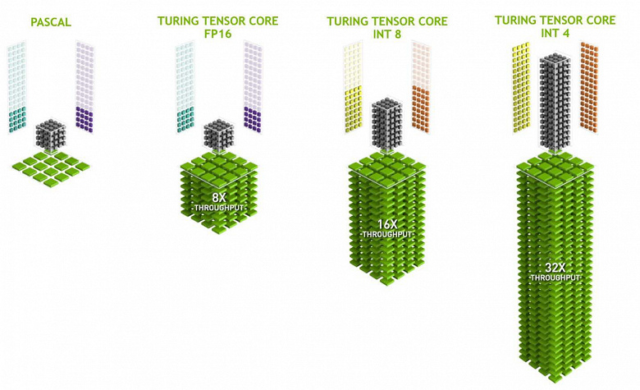

А в 2018 году произошла еще одна революция — появилась архитектура Тьюринга, а вместе с ней и новые типы ядер и, конечно же, технологии трассировки лучей. Давайте сначала поговорим о ней.

Трассировка лучей

Что такое трассировка лучей? Несмотря на то, что видеокарты за годы своей эволюции чрезмерно выросли с поддержкой множества эффектов. Игры стали выглядеть действительно круто. Но все же они остались выглядеть как игры. Почему?

Дело в том, что до технологии трассировки лучей игры не имели настоящего глобального просвещения. Он рассчитывался для каждого объекта отдельно и по очереди. В результате нам не удалось рассчитать, как объекты влияют друг на друга, как свет преломляется и отражается между разными объектами. И все глобальное освещение сцены просто заранее было «запечено» в сюжетную линию в графическом редакторе игры. Также существуют зонды и множество других методик, позволяющих получить грубую имитацию глобального освещения с рядом недостатков: поток света через объекты, повышенные требования к видеопамяти, отсутствие физики, т.к сцена меняется, поэтому освещение придется пересчитывать, а использование подготовленных ресурсов невозможно.

Но впервые трассировка лучей позволила строить освещение по законам природы и сняла ряд ограничений. Ну в принципе. Как это работает?

Вместо того, чтобы считывать освещение для каждого объекта по отдельности, сначала визуализируется вся трехмерная сцена и упаковывается в блоки BVH для ускорения отслеживания. После этого луч из камеры запускается в компактную 3D-сцену и мы наблюдаем, с какой поверхностью он будет пересекаться. А дальше от этой точки строится луч для каждого источника света. Так мы понимаем, где свет, а где тень.

А если луч попадает в отражающий объект, создается другой отраженный луч, и мы можем подсчитать больше отражений. Чем больше отражений мы посчитаем, тем сложнее будет ошибка расчета, но тем реалистичнее будет результат.

Все почти как в жизни, но для экономии ресурсов лучи сбрасываются не от источника света, а от камеры. В противном случае вам пришлось бы рассчитывать множество лучей, которые не попадают в поле зрения игрока, то есть производить ненужные вычисления, которые занимают ресурсы графического процессора.

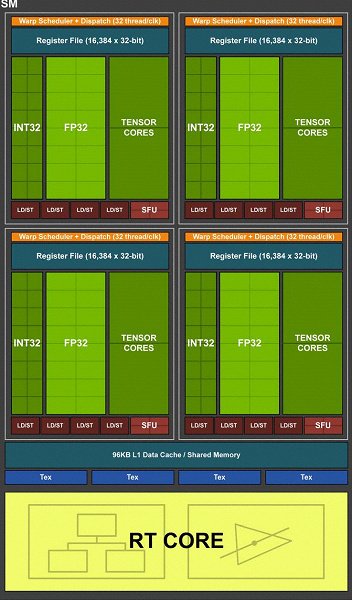

Новые ядра

Для реализации трассировки лучей, помимо ядер CUDA, нам пришлось изобрести ядро нового типа. Это ядра RT, что на самом деле означает ядра трассировки лучей и тензорные ядра.

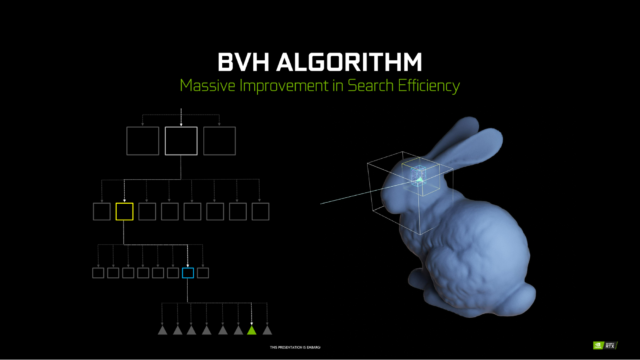

Ядра RT выполняют такой же поиск пересечений между радиусом и полигонами сцены. И они делают это очень эффективно благодаря алгоритму BVH — Bounding Volume Hierarchy.

Суть алгоритма: каждый многоугольник помещается в несколько ящиков разного размера, как матрешка. И вместо того, чтобы проверять пересечения с каждым многоугольником сцены, которых миллионы, мы сначала проверяем, попадает ли луч в небольшое количество ящиков, в которые упакованы треугольники сцены. Последний уровень BVH матрешки содержит ячейку с различные треугольники сцены. Ящики намного меньше треугольников, поэтому на тестирование сцены уходит гораздо меньше времени, чем на итерацию по каждому треугольнику в сцене.

Тензорные ядра вообще необычны для видеокарты. Такие ядра используются для операций умножения матриц. То есть они могут умножать сразу много чисел. Это очень полезно для обучения глубоких нейронных сетей. Поэтому, как правило, нейросети сейчас обучаются и используются на видеокартах.

Но даже в играх тензорные ядра имеют большой вес. Во-первых, путем удаления шума из изображения с трассировкой лучей в профессиональных пакетах с поддержкой OptiX.

Но в первую очередь за реализацию фирменной технологии DLSS — Deep Learning Super Sampling. Это технология сглаживания и масштабирования изображений с помощью нейронных сетей. Например, у вас есть монитор 4K, но видеокарта не тянет ультрас 4K. Что делает DLSS в этом случае. Изображение отображается с более низким разрешением 1440P или 1080P, затем несколько смежных кадров объединяются нейронной сетью в новый кадр с более высоким разрешением. Настолько, что часто выглядит даже лучше, чем родное разрешение. В то же время мы получаем огромный прирост частоты кадров.

Слишком много технологий! В этом можно запутаться, поэтому для систематизации мыслей пройдемся по этапам работы видеокарты.

Чем отличаются видеокарты?

Хорошо, вроде мы понимаем принцип работы видеокарты. Теперь поговорим о том, почему одни видеокарты быстрее, а другие медленнее.

Во-первых, генерация влияет на скорость и возможности видеокарты. Например, до появления серии GeForce RTX 20 не было трассировки лучей и прочих вкусностей. Но если говорить о производительности внутри поколения, то нас интересуют 4 параметра:

- Количество ядер и других исполнительных единиц

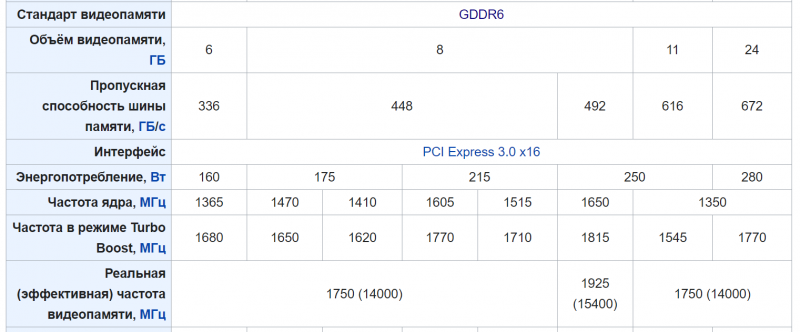

- Скорость и размер памяти

- Центральная частота

- Дизайн

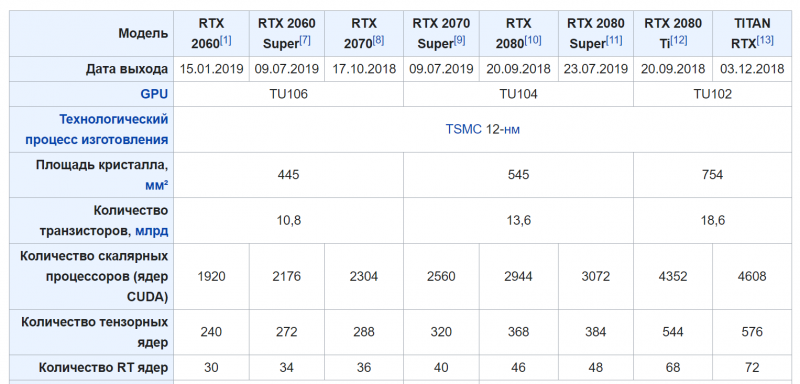

Допустим, мы сравниваем двадцатую серию.

В RTX 2060 — 1920 ядер CUDA и в 2080 Ti — 4352. В результате в общих задачах можно рассчитывать примерно на 2-х кратное повышение производительности. С частотой ядра и объемом памяти думаю тоже все понятно. Больше лучше.

Дизайн

Дело в том, что NVIDIA только производит чипы и показывает референсный дизайн видеокарты. А потом каждый производитель сам решает, какую систему охлаждения установить и какого размера сделать видеокарту. Следовательно, чем лучше охлаждение, тем выше рабочая частота и производительность.

Но дизайн также означает форм-фактор. Дело в том, что большие видеокарты, например, просто не могут поместиться в ноутбук физически. И даже если они поместятся, энергопотребление внутри них будет запредельным. Поэтому существуют мобильные модификации видеокарт, которые просто припаяны к материнской плате. Модификации мобильных карт отличаются пониженными частотами и энергопотреблением.

Есть два типа мобильных дизайнов:

- Только мобильный. Это толстые версии игровых ноутбуков, они не сильно отличаются по производительности от настольных версий. Иногда такие карты называют Max-P, тип исполнения. А иногда вообще ничего не приписывают. Но не обольщайтесь ноутбуком, мобильной версии быть не может.

- И есть дизайн Max-Q. Ставьте такие карты в тонкие игровые ноутбуки. У них значительно меньше энергопотребление, но частоты срезаются сильнее.

| RTX 2080 Супер | RTX 2080 Super Mobile (Max-P) | RTX 2080 Супер Макс-Q | |

| Ядро CUDA | 3072 | 3072 | 3072 |

| Частота яда | 1650 МГц | 1365 МГц | 975 МГц |

| Увеличьте частоту | 1815 МГц | 1560 МГц | 1230 МГц |

| Потребляемая мощность (TDP) | 250 Вт | 150 Вт | 80 Вт |

Проверим на практике

По производительности игровые ноутбуки близки к настольным. Но ноутбуки более доступны за счет форм-фактора. GeForce GTX в порядке, нормальный начальный уровень. RTX — лучший выбор для геймеров. Кроме того, графический процессор RTX ускоряет более 50 настольных приложений. Оптимальный выбор для работы и отдыха. Но хватит теории. Проверяем на практике, насколько разные карты отличаются по производительности.

У нас есть 3 ноутбука. Вот с таким железом.

ASUS ROG Zephyrus G15

Ryzen 7 4800HS

NVIDIA GeForce GTX 1650 Ti 4 ГБ

ASUS ROG Zephyrus G14

Ryzen 9 4900HS

NVIDIA GeForce RTX 2060 Max-Q 6 ГБ

ASUS ROG Zephirus DUO

Intel Core i9-10980HK

GeForce RTX 2080 SUPER Max-Q 8 ГБ

Все три версии имеют разные процессоры, но все они мощные, поэтому не должны сильно влиять на результат теста. По крайней мере, они точно не будут узким местом.

| GTX 1650 Ti мобильная | RTX 2060 Макс-Q | RTX 2080 Супер Макс-Q | |

| Ядро CUDA | 1024 | 1920 г | 3072 |

| Центральная частота | 1350 МГц | 975 МГц | 975 МГц |

| Увеличьте частоту | 1485 МГц | 1185 МГц | 1230 МГц |

| Тензор ядра | — | 240 | 384 |

| Ядра RT | — | тридцать | 48 |

| Размер видеопамяти | 4ГБ | 6 ГБ | 8 ГБ |

| Потребляемая мощность (TDP) | 65 Вт | 50 Вт | 80 Вт |

И для начала несколько синтетических тестов. Согласно тесту 3DMark Time Spy, дизайн 2080 Super в Max-Q превосходит 2060 на 25% и 1650 Ti на 51%. Это означает, что мы ожидаем, что 2080 будет примерно вдвое увеличивать частоту кадров. Посмотрим, так ли это на практике.

- GTX 1650 Ti (мобильная) — 3948 (-51,7%)

- RTX 2060 Max-Q — 6090 (-25,5%)

- RTX 2080 Супер Макс Q — 8170

Тест Cyberpunk 2077

Мы проверили все про Cyberpunk 2077 с версией 1.04 на не очень загруженной сцене, в закрытом месте. Однако с наличием экшена. Все ноутбуки работали в режиме повышенной производительности.

Следовательно, Cyberpunk 2077 имеет 6 стандартных предустановок графики: низкий, средний, высокий, впечатляющий. И есть еще две настройки трассировки лучей: впечатляющие настройки + Среднее качество трассировки или Ультра качество. В отслеживаемых предустановках DLSS сразу включается в автоматическом режиме. Об этом стоит подумать.

Так на что способны наши видеокарты?

Во-первых, 1650 Ti показал себя очень хорошо, потому что он выдавал супер-воспроизводимую частоту кадров при высоких настройках графики — стабильные 30+ кадров в секунду с редкими просадками до 25. А средние настройки оказались вполне воспроизводимыми — это 35-40 кадров в секунду.

Источники

- https://2bitcoins.ru/kak-uvelichit-heshrejt-v-majninge/

- https://cryptoage.com/ru/2575-%D1%81%D0%BF%D0%BE%D1%81%D0%BE%D0%B1%D1%8B-%D0%BE%D0%BF%D1%80%D0%B5%D0%B4%D0%B5%D0%BB%D0%B5%D0%BD%D0%B8%D1%8F-%D0%B2%D0%B8%D0%B4%D0%B5%D0%BE%D0%BA%D0%B0%D1%80%D1%82-nvidia-geforce-rtx-30-%D1%81-%D0%BE%D0%B3%D1%80%D0%B0%D0%BD%D0%B8%D1%87%D0%B8%D1%82%D0%B5%D0%BB%D0%B5%D0%BC-%D0%BC%D0%B0%D0%B9%D0%BD%D0%B8%D0%BD%D0%B3%D0%B0-lhr.html

- https://itinru.ru/komplektujushhie-i-aksessuary/9208-chto-znachit-ti-v-videokartah-nvidia-sravnenie-videokart/

- https://cdd-evo.ru/otlichie-gtx-chto-znachit-ti-v-videokartah-nvidia-lineiki-i/

- https://droider.ru/post/kak-rabotaet-videokarta-nvidia-razbor-29-12-2020/